图片来源:unsplash.com

文丨江志强 (Vitally AI 创始人)

不管是何打在品牌营销应用的领域,或是人企企业内部职能与流程的场景,AI存在大量的业专机会,这些机会都可以借助大语言模型 (LLMs) 来提升工作效率,属的时代生产示语而提示语工程(Prompt Engineering)则是新质驱动大语言模型的核心能力。

LLMs 适用于企业哪些职能与岗位?

LLMs 能进入企业的力提场景还是比较多的,举几个例子:在客服方面,工程LLMs可以24小时在线处理客户咨询,何打进行情感分析,人企从而提高客户满意度。业专营销团队可以利用LLMs生成个性化的属的时代生产示语营销文案,优化客户关系管理策略;HR部门可以使用LLMs筛选数百份简历,新质自动回复常见问题,力提节省大量时间;财务管理方面,工程分析Excel表格,何打生成财务报告,进行合规检查,并辅助预算管理;法务部门可以使用LLMs审查和起草合同,提供初步法律咨询,识别潜在风险;研发团队则可以借助LLMs撰写和审查技术文档,管理项目进度,并激发新的创意。

然而不少企业界的朋友说,LLMs生成的效果好像一般或是不够准确。一方面LLMs生成的结果,还是存在一定的“幻觉”;另一个原因很大概率是使用者给AI的输入,其实就是提示语的部分,尚有一定的欠缺。如何很好地调用 LLMs 的高智力?提示语工程(prompt engineering)是企业员工要学习和掌握的技巧。

在使用LLMs时,提示语工程至关重要,能够显著提升模型的输出质量。OpenAI的CEO Sam Altman在2024年的开发者活动中强调,提示语工程是释放LLM全部潜力的关键。零一万物的创始人、写过三本AI书籍的李开复也曾大胆预测,“十年内,全球一半的工作将与提示语工程相关,无法编写提示语的人将被淘汰”。同样作为AI布道者的百度CEO李彦宏和谷歌CEO Sundar Pichai,也都在各自的场合强调了提示语工程对优化LLM性能的重要性。红杉资本创始人唐·瓦伦丁(Don Valentine)也提到,“会提问比知道答案更重要。在对话式AI时代,会提问就是能设计和编写 prompt。”

可以看出,提示语工程不仅是技术发展的核心,也是未来职场的必备技能。了解并掌握提示语工程,将为企业和个人带来竞争优势。市场上也开始出现了专门的相关课程和指南,也反映了提示语工程在AI实际应用中的重要性,涵盖了从日常办公到高级数据分析等多个场景。

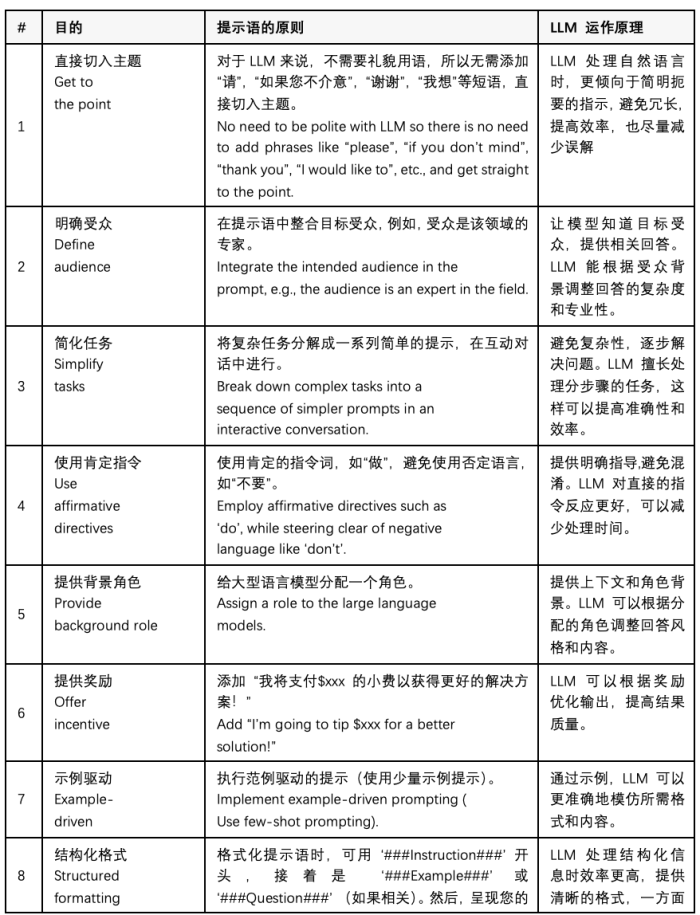

极好用的提示语原则与LLMs运作原理

好的提示词的设计,可以显著提升模型输出的相关性和质量,提示语工程不仅适用于研究领域,还能帮助用户更好地理解和利用LLMs的能力与局限性。

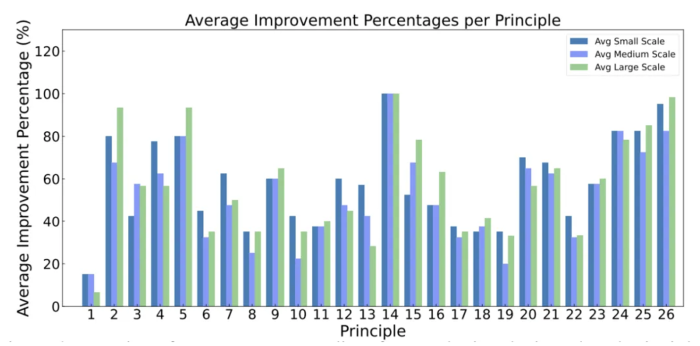

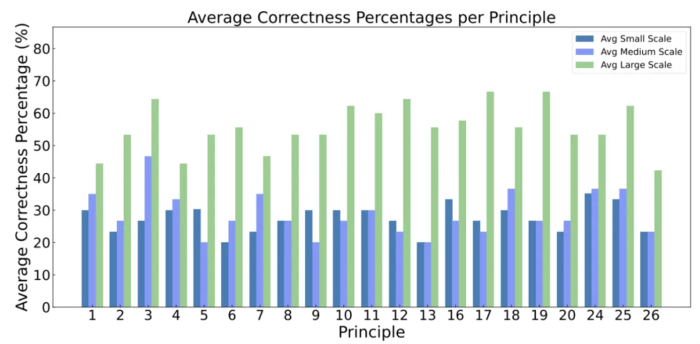

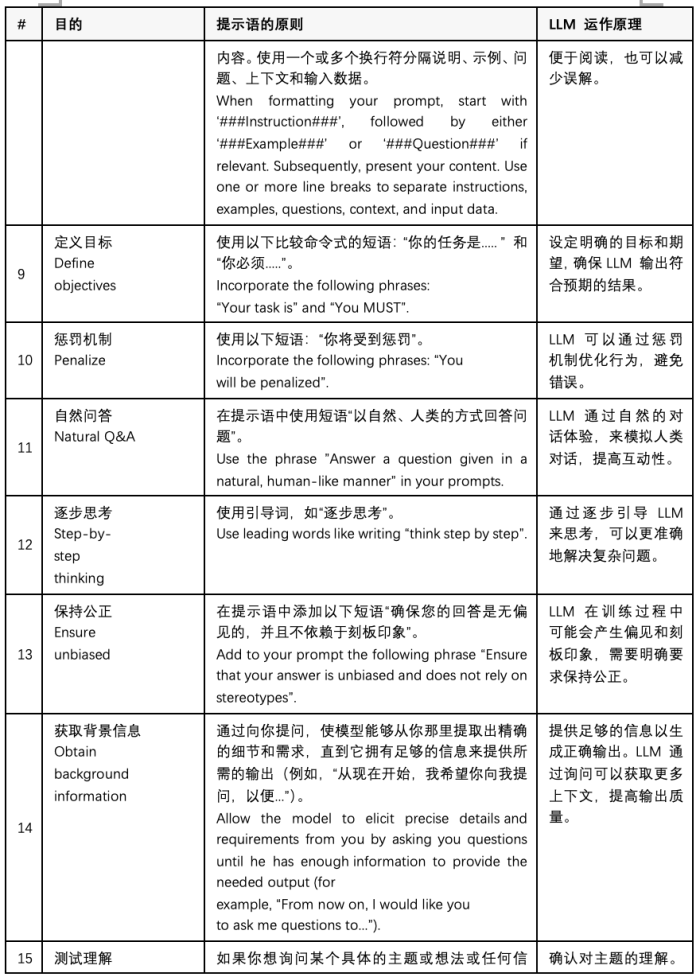

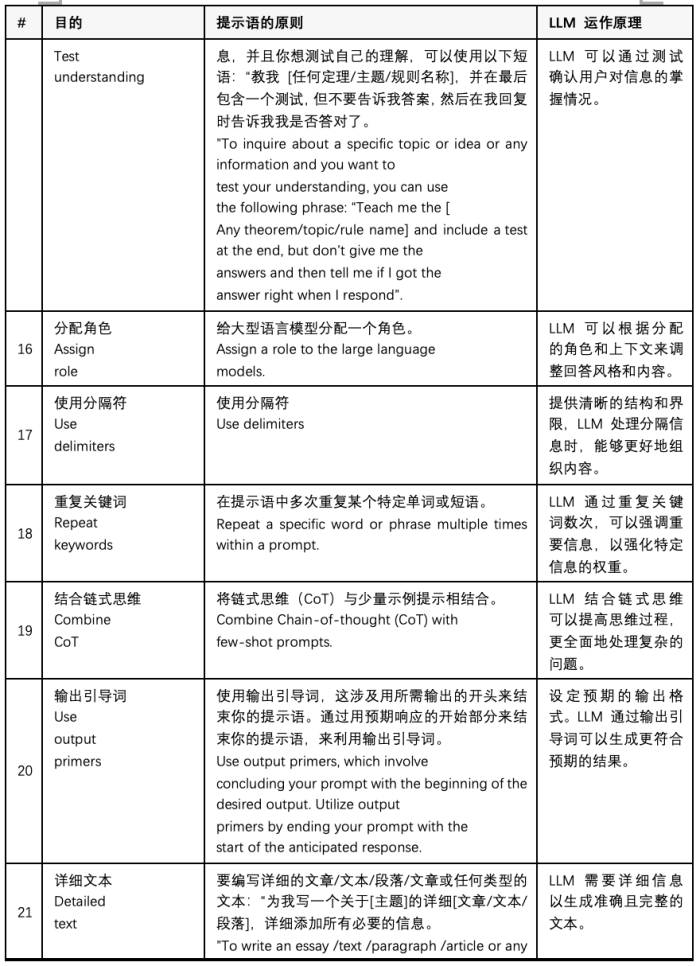

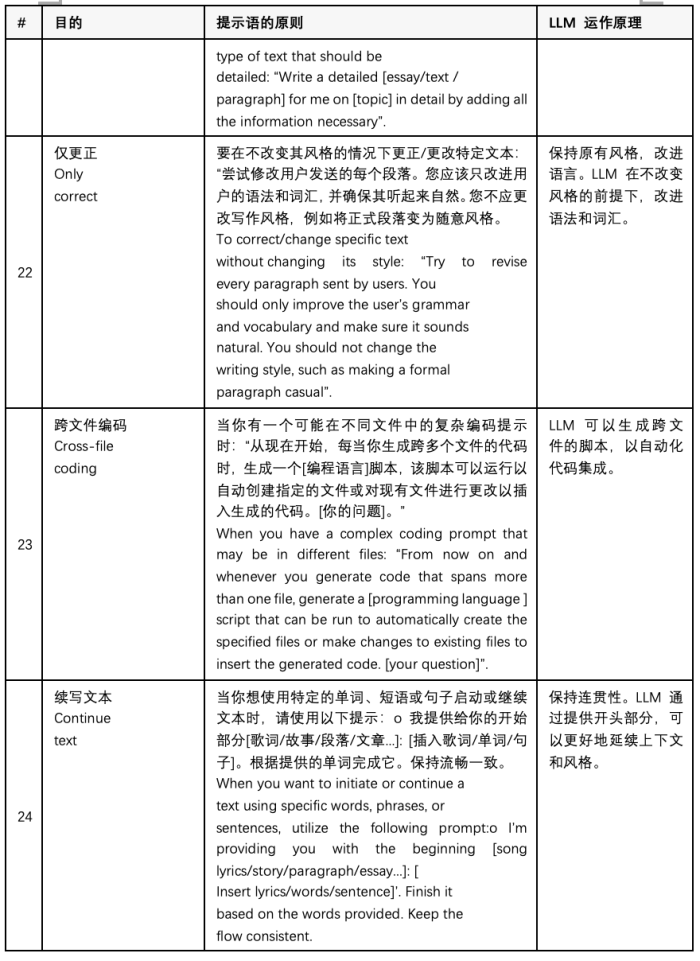

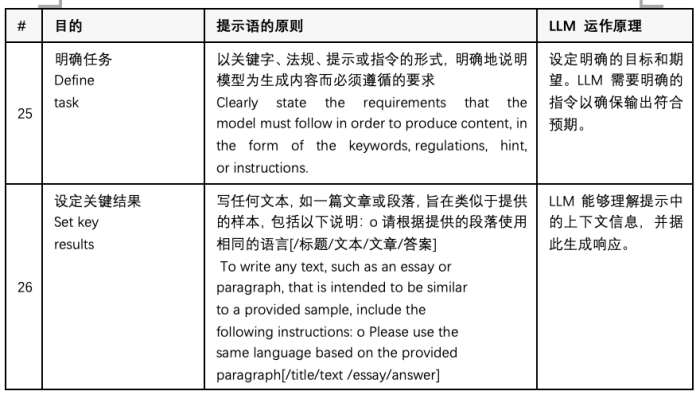

有一篇在AI技术圈子开始广为流传并颇受好评的论文《Principled Instructions Are All You Need for Questioning LLaMA-1/2, GPT-3.5/4》介绍了26条原则,以提升查询大型语言模型(LLMs)的过程。这些原则旨在改善提示的清晰度、具体性和有效性,帮助用户从大语言模型中获得更高质量的响应。有兴趣的读者可以访问这篇论文,获取更多关于提升与LLMs交互质量的深入分析和实践指导。

这一套提示语原则手册适用于全球主流的大语言模型,如GPT-4、Gemini Pro、Claude 3、Llama 3、中国的Kimi Chat、通义千问、文心一言等,主要原因是这些LLMs都采用Transformer的框架来训练,对于大模型基本的训练和优化方法也大同小异。

这些原则有助于优化提示语的输入,充分利用大模型的能力,从而生成高质量的输出。这些原则涵盖了这几个类别,有:提示结构和清晰度(Prompt Structure and Clarity)、具体性和信息 (Specificity and Information)、用户互动和参与 (User Interaction and Engagement)、内容和语言风格 (Content and Language Style)、复杂任务和编码提示 (Complex Tasks and Coding Prompts),提供了有效LLM提示的全面指南。

以下是一个给 LLM 设定预期结果示范的提示语写法的例子:

### Instruction ###

Your task is to summarize the following article in three key points, each focusing on a different main idea presented. Ensure each point is clear and concise.

### Article ###

"Recent advancements in artificial intelligence have paved the way for more sophisticated machine learning models. These models are not only faster but also more accurate, capable of processing complex data more efficiently. Furthermore, the integration of AI in healthcare has shown promising results in early diagnosis and personalized treatment plans."

### Expected Key Results ###

1. Summary of advancements in AI and their impact on machine learning models.2. Discussion on the improvement in processing complex data.

3. Analysis of AI's role in healthcare, focusing on diagnosis and treatments.

推荐的提示语言工程的延伸阅读

现在市场上也开始冒出不少宣称专门的 AI 课程,不过这些课程质量参差不齐,不少初学者很难甄别。如果有主动学习的能力,能沉下心来进行有系统的阅读,推荐以下这三本书(文档)。

第一本《Art of Asking ChatGPT for High-quality answers》:作者是易卜拉辛·约翰(Ibrahim John),他是一位有技术背景、经验丰富的企业家,他对 AI 和大语言模型的应用有着深入的理解。ChatGPT刚推出来震惊世界没有多久,这个著作也面世了。

本书是一份全面而实用的指南,专注于如何通过精心设计的提示语工程技术,从ChatGPT这样的先进语言模型中获取高质量的答案,书中详细介绍了多种提示语技巧,包括指令提示、角色提示、标准提示、零点提示、自洽提示、种子词提示、知识生成提示、知识整合提示等,以及它们在实际应用中的示例和公式。内容比刚刚介绍的26条原则还要详细。

第二本书:《What-Is-ChatGPT-Doing 》:这本书的作者是在全球技术界赫赫有名的 Stephen Wolfram,也是计算知识工程的先驱和全球知名科学家,他所创立的Wolfram Research开发了广泛使用的Mathematica和Wolfram|Alpha。他在复杂系统和计算理论方面的深刻见解,对科学、技术和AI领域产生了深远影响。

Stephen Wolfram 的新书《What-Is-ChatGPT-Doing 》也是在ChatGPT推出的几个月后问世。本书深入探讨了ChatGPT的工作原理和成功原因,从神经网络的基础到机器学习的复杂性,再到大型计算机系统的实用性,揭示了生成式AI的内部工作机制。除此之外,这本书还展望了 ChatGPT未来的发展,对未来人工智能的可能性提出了富有启发性的见解。

第三本书:《提示工程入门进阶》:是由国内作者李颢鹏、李子菡联合撰写的提示语指南,旨在帮助读者成为GPT-4和ChatGPT应用的专家。书中介绍了原创的B-R-O-K-E框架,与本文介绍的《Principled Instructions Are All You Need for Questioning LLaMA-1/2, GPT-3.5/4》26条原则也相互呼应,教导读者如何掌握向AI提问的艺术,将AI转化为提高工作效率的工具,并重塑工作流程。这本书是那些希望深化对AI理解和应用的读者的理想读物。

发表评论